Распределение хи-квадрат

Функция плотности вероятности  | |||

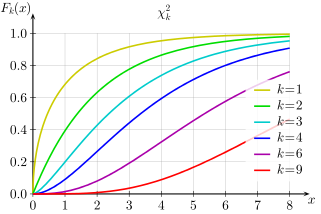

Кумулятивная функция распределения  | |||

| Обозначение | или | ||

|---|---|---|---|

| Параметры | (известные как «степени свободы») | ||

| Поддерживать | |||

| СДФ | |||

| Иметь в виду | |||

| Медиана | |||

| Режим | |||

| Дисперсия | |||

| Асимметрия | |||

| Избыточный эксцесс | |||

| Энтропия | |||

| МГФ | |||

| CF | [1] | ||

| ПГФ | |||

В теории вероятностей и статистике распределение хи-квадрат (также хи-квадрат или -распределение ) со степенями свободы представляет собой распределение суммы квадратов независимых стандартных нормальных случайных величин. [2]

Распределение хи-квадрат является частным случаем гамма-распределения и одномерного распределения Уишарта . В частности, если то (где — параметр формы и параметр масштаба гамма-распределения) и .

Масштабированное распределение хи-квадрат является репараметризацией гамма-распределения и одномерного распределения Уишарта . В частности, если то и .

Распределение хи-квадрат является одним из наиболее широко используемых распределений вероятностей в статистике вывода , особенно при проверке гипотез и построении доверительных интервалов . [3] [4] [5] [6] Это распределение иногда называют центральным распределением хи-квадрат , частным случаем более общего нецентрального распределения хи-квадрат . [7]

Распределение хи-квадрат используется в общих тестах хи-квадрат для проверки соответствия наблюдаемого распределения теоретическому, независимости двух критериев классификации качественных данных и при нахождении доверительного интервала для оценки среднеквадратического отклонения популяции нормального распределения от среднеквадратического отклонения выборки. Многие другие статистические тесты также используют это распределение, например, дисперсионный анализ Фридмана по рангам .

Определения

Если Z 1 , ..., Z k — независимые стандартные нормальные случайные величины, то сумма их квадратов,

распределено по закону хи-квадрат с k степенями свободы. Обычно это обозначается как

Распределение хи-квадрат имеет один параметр: положительное целое число k , которое определяет число степеней свободы (число суммируемых случайных величин, Z i s).

Введение

Распределение хи-квадрат используется в основном при проверке гипотез и в меньшей степени для доверительных интервалов для дисперсии популяции, когда лежащее в основе распределение является нормальным. В отличие от более широко известных распределений, таких как нормальное распределение и экспоненциальное распределение , распределение хи-квадрат не так часто применяется при прямом моделировании природных явлений. Оно возникает при следующих проверках гипотез, среди прочих:

- Тест хи-квадрат независимости в таблицах сопряженности

- Хи-квадрат тест качества соответствия наблюдаемых данных гипотетическим распределениям

- Тест отношения правдоподобия для вложенных моделей

- Логранговый тест в анализе выживаемости

- Тест Кохрана-Мантеля-Хензеля для стратифицированных таблиц сопряженности

- тест Вальда

- Тест на оценку

Он также является компонентом определения t -распределения и F -распределения , используемых в t -тестах, дисперсионном анализе и регрессионном анализе.

Основная причина, по которой распределение хи-квадрат широко используется при проверке гипотез, заключается в его связи с нормальным распределением. Многие проверки гипотез используют тестовую статистику, например, t -статистику в t -тесте. Для этих проверок гипотез по мере увеличения размера выборки n распределение выборки тестовой статистики приближается к нормальному распределению ( центральная предельная теорема ). Поскольку тестовая статистика (например, t ) распределена асимптотически нормально, при условии, что размер выборки достаточно велик, распределение, используемое для проверки гипотез, может быть аппроксимировано нормальным распределением. Проверка гипотез с использованием нормального распределения хорошо понятна и относительно проста. Простейшее распределение хи-квадрат является квадратом стандартного нормального распределения. Поэтому везде, где для проверки гипотез можно использовать нормальное распределение, можно использовать распределение хи-квадрат.

Предположим, что — случайная величина, выбранная из стандартного нормального распределения, где среднее значение равно , а дисперсия равна : . Теперь рассмотрим случайную величину . Распределение случайной величины является примером распределения хи-квадрат: . Нижний индекс 1 указывает на то, что это конкретное распределение хи-квадрат построено только из 1 стандартного нормального распределения. Говорят, что распределение хи-квадрат, построенное путем возведения в квадрат одного стандартного нормального распределения, имеет 1 степень свободы. Таким образом, по мере увеличения размера выборки для проверки гипотезы распределение тестовой статистики приближается к нормальному распределению. Так же, как экстремальные значения нормального распределения имеют низкую вероятность (и дают малые p-значения), экстремальные значения распределения хи-квадрат имеют низкую вероятность.

Еще одной причиной того, что распределение хи-квадрат широко используется, является то, что оно оказывается распределением большой выборки обобщенных тестов отношения правдоподобия (LRT). [8] LRT обладают несколькими желательными свойствами; в частности, простые LRT обычно обеспечивают наивысшую мощность для отклонения нулевой гипотезы ( лемма Неймана–Пирсона ), и это также приводит к свойствам оптимальности обобщенных LRT. Однако нормальное и хи-квадрат приближения действительны только асимптотически. По этой причине предпочтительнее использовать t- распределение, а не нормальное приближение или хи-квадрат приближение для небольшого размера выборки. Аналогично, при анализе таблиц сопряженности приближение хи-квадрат будет плохим для небольшого размера выборки, и предпочтительнее использовать точный тест Фишера . Рэмси показывает, что точный биномиальный тест всегда более мощный, чем нормальное приближение. [9]

Ланкастер показывает связи между биномиальным, нормальным и хи-квадрат распределениями следующим образом. [10] Де Муавр и Лаплас установили, что биномиальное распределение может быть аппроксимировано нормальным распределением. В частности, они показали асимптотическую нормальность случайной величины

где — наблюдаемое число успехов в испытаниях, где вероятность успеха равна , и .

Возведение обеих частей уравнения в квадрат дает

Используя , , и , это уравнение можно переписать как

Выражение справа имеет форму, которую Карл Пирсон обобщил бы до формы

где

= Статистика кумулятивного теста Пирсона, которая асимптотически приближается к распределению; = число наблюдений типа ; = ожидаемая (теоретическая) частота типа , утверждаемая нулевой гипотезой о том, что доля типа в популяции равна ; и = число ячеек в таблице. [ необходима ссылка ]

В случае биномиального результата (подбрасывание монеты) биномиальное распределение может быть аппроксимировано нормальным распределением (для достаточно большого ). Поскольку квадрат стандартного нормального распределения является распределением хи-квадрат с одной степенью свободы, вероятность результата, такого как 1 орёл в 10 испытаниях, может быть аппроксимирована либо с помощью прямого использования нормального распределения, либо распределения хи-квадрат для нормализованной квадратичной разницы между наблюдаемым и ожидаемым значением. Однако многие задачи включают в себя больше, чем два возможных результата биномиального распределения, и вместо этого требуют 3 или более категорий, что приводит к полиномиальному распределению. Так же, как де Муавр и Лаплас искали и нашли нормальное приближение к биномиальному, Пирсон искал и нашел вырожденное многомерное нормальное приближение к полиномиальному распределению (числа в каждой категории складываются в общий размер выборки, который считается фиксированным). Пирсон показал, что распределение хи-квадрат возникло из такого многомерного нормального приближения к полиномиальному распределению, тщательно учитывая статистическую зависимость (отрицательные корреляции) между числами наблюдений в различных категориях. [10]

Функция плотности вероятности

Функция плотности вероятности (pdf) распределения хи-квадрат равна

где обозначает гамма-функцию , которая имеет замкнутые значения для целых чисел .

Для вывода функции PDF в случаях одной, двух и более степеней свободы см. Доказательства, связанные с распределением хи-квадрат .

Кумулятивная функция распределения

Его кумулятивная функция распределения имеет вид:

где — нижняя неполная гамма-функция , а — регуляризованная гамма-функция .

В частном случае эта функция имеет простой вид:

который можно легко получить путем прямого интегрирования. Целочисленная повторяемость гамма-функции позволяет легко вычислять для других малых, даже .

Таблицы кумулятивной функции распределения хи-квадрат широко доступны, и эта функция включена во многие электронные таблицы и все статистические пакеты .

Полагая , можно получить границы Чернова на нижнем и верхнем хвостах функции распределения. [11] Для случаев, когда (включая все случаи, когда эта функция распределения меньше половины):

Хвостовая граница для случаев, когда , аналогично, равна

Другую аппроксимацию для CDF, смоделированной на основе куба гауссовой функции, см. в разделе Нецентральное распределение хи-квадрат .

Характеристики

Теорема Кохрана

Ниже приведен частный случай теоремы Кохрана.

Теорема. Если — независимые одинаково распределенные (iid), стандартные нормальные случайные величины, то где

Доказательство. Пусть — вектор независимых нормально распределенных случайных величин, а их среднее значение. Тогда где — единичная матрица и вектор из всех единиц. имеет один собственный вектор с собственным значением и собственные векторы (все ортогональные к ) с собственным значением , которые можно выбрать так, чтобы — ортогональная матрица. Поскольку также , то имеем что доказывает утверждение.

Аддитивность

Из определения распределения хи-квадрат следует, что сумма независимых переменных хи-квадрат также распределена по закону хи-квадрат. В частности, если — независимые переменные хи-квадрат с , степенями свободы, соответственно, то — распределена по закону хи-квадрат со степенями свободы.

Выборочное среднее

Выборочное среднее значение iid хи-квадрат переменных степени распределено в соответствии с гамма-распределением с параметрами формы и масштаба :

Асимптотически, учитывая, что для параметра формы, стремящегося к бесконечности, гамма-распределение сходится к нормальному распределению с математическим ожиданием и дисперсией , выборочное среднее сходится к:

Обратите внимание, что мы получили бы тот же результат, применив вместо этого центральную предельную теорему , отметив, что для каждой переменной хи-квадрат степени ожидание равно , а ее дисперсия (и, следовательно, дисперсия выборочного среднего равна ).

Энтропия

Дифференциальная энтропия определяется как

где - дигамма-функция .

Распределение хи-квадрат — это распределение вероятности максимальной энтропии для случайной переменной , для которой и фиксированы. Поскольку хи-квадрат принадлежит к семейству гамма-распределений, его можно вывести, подставив соответствующие значения в Expectation of the log moment of gamma . Для вывода из более базовых принципов см. вывод в moment-generating function of the enough statistic .

Нецентральные моменты

Нецентральные моменты (сырые моменты) распределения хи-квадрат со степенями свободы определяются как [12] [13]

Кумулянты

Кумулянты легко получаются путем разложения в степенной ряд логарифма характеристической функции:

Концентрация

Распределение хи-квадрат демонстрирует сильную концентрацию вокруг своего среднего значения. Стандартные границы Лорана-Массара [14] таковы:

Одним из следствий этого является то, что если — гауссовский случайный вектор в , то по мере роста размерности квадрат длины вектора плотно концентрируется вокруг с шириной : где показатель степени может быть выбран равным любому значению в .

Асимптотические свойства

По центральной предельной теореме , поскольку распределение хи-квадрат является суммой независимых случайных величин с конечным средним значением и дисперсией, оно сходится к нормальному распределению при больших . Для многих практических целей, для распределение достаточно близко к нормальному распределению , поэтому разницей можно пренебречь. [15] В частности, если , то при стремлении к бесконечности распределение стремится к стандартному нормальному распределению. Однако сходимость медленная, поскольку асимметрия равна , а избыточный эксцесс равен .

Распределение выборки сходится к нормальному распределению гораздо быстрее, чем распределение выборки , [16], поскольку логарифмическое преобразование устраняет большую часть асимметрии. [17]

Другие функции распределения хи-квадрат сходятся к нормальному распределению быстрее. Вот некоторые примеры:

- Если то распределено приблизительно нормально со средним значением и единичной дисперсией (1922, по RA Fisher , см. (18.23), стр. 426 Джонсона. [5]

- Если то приблизительно нормально распределено со средним значением и дисперсией [18] Это известно как преобразование Уилсона–Хилферти , см. (18.24), стр. 426 Джонсона. [5]

- Это нормализующее преобразование приводит непосредственно к широко используемой медианной аппроксимации путем обратного преобразования из среднего значения, которое также является медианой нормального распределения.

Связанные дистрибутивы

This section needs additional citations for verification. (September 2011) |

- Как , ( нормальное распределение )

- ( нецентральное распределение хи-квадрат с параметром нецентральности )

- Если тогда имеет распределение хи-квадрат

- В частном случае, если тогда имеет распределение хи-квадрат

- ( Квадрат нормы k стандартных нормально распределенных переменных представляет собой распределение хи-квадрат с k степенями свободы )

- Если и , то . ( гамма-распределение )

- Если тогда ( хи-распределение )

- Если , то — экспоненциальное распределение . (Подробнее см. в разделе гамма-распределение .)

- Если , то — распределение Эрланга .

- Если , то

- Если ( распределение Рэлея ), то

- Если ( распределение Максвелла ), то

- Если тогда ( Обратное распределение хи-квадрат )

- Распределение хи-квадрат является частным случаем распределения Пирсона типа III.

- Если и независимы, то ( бета-распределение )

- Если ( равномерное распределение ), то

- Если тогда

- Если следует обобщенное нормальное распределение (версия 1) с параметрами , то [19]

- Распределение хи-квадрат является преобразованием распределения Парето.

- Распределение Стьюдента — это преобразование распределения хи-квадрат.

- Распределение Стьюдента можно получить из распределения хи-квадрат и нормального распределения.

- Нецентральное бета-распределение может быть получено как преобразование распределения хи-квадрат и нецентрального распределения хи-квадрат

- Нецентральное t-распределение можно получить из нормального распределения и распределения хи-квадрат.

Переменная хи-квадрат со степенями свободы определяется как сумма квадратов независимых стандартных нормальных случайных величин.

Если — -мерный гауссовский случайный вектор со средним вектором и ранговой ковариационной матрицей , то — распределено по закону хи-квадрат со степенями свободы.

Сумма квадратов статистически независимых гауссовских переменных с единичной дисперсией, не имеющих нулевого среднего, дает обобщение распределения хи-квадрат, называемое нецентральным распределением хи-квадрат .

Если — вектор независимых стандартных нормальных случайных величин и — симметричная идемпотентная матрица с рангом , то квадратичная форма распределена по закону хи-квадрат со степенями свободы.

Если — положительно-полуопределенная ковариационная матрица со строго положительными диагональными элементами, то для и случайного -вектора, независимого от , такого, что и тогда

- [17]

Распределение хи-квадрат также естественным образом связано с другими распределениями, вытекающими из гауссовского. В частности,

- распределено по закону F , если , где и статистически независимы.

- Если и статистически независимы, то . Если и не являются независимыми, то не распределено по закону хи-квадрат.

Обобщения

Распределение хи-квадрат получается как сумма квадратов k независимых, с нулевым средним и единичной дисперсией гауссовских случайных величин. Обобщения этого распределения могут быть получены путем суммирования квадратов других типов гауссовских случайных величин. Несколько таких распределений описаны ниже.

Линейная комбинация

Если — случайные величины хи-квадрат и , то распределение является частным случаем обобщенного распределения хи-квадрат . Замкнутое выражение для этого распределения неизвестно. Однако его можно эффективно аппроксимировать, используя свойство характеристических функций случайных величин хи-квадрат. [20]

Распределение хи-квадрат

Нецентральное распределение хи-квадрат

Нецентральное распределение хи-квадрат получается из суммы квадратов независимых гауссовских случайных величин, имеющих единичную дисперсию и ненулевые средние значения.

Обобщенное распределение хи-квадрат

Обобщенное распределение хи-квадрат получается из квадратичной формы z'Az, где z — гауссовский вектор с нулевым средним, имеющий произвольную ковариационную матрицу, а A — произвольная матрица.

Гамма, экспоненциальное и родственные распределения

Распределение хи-квадрат является частным случаем гамма-распределения , поскольку использует параметризацию скорости гамма-распределения (или использует параметризацию масштаба гамма-распределения), где k — целое число.

Поскольку экспоненциальное распределение также является частным случаем гамма-распределения, мы также имеем, что если , то — экспоненциальное распределение .

Распределение Эрланга также является частным случаем гамма-распределения, и поэтому мы также имеем, что если при четном , то является распределением Эрланга с параметром формы и параметром масштаба .

Возникновение и применение

Распределение хи-квадрат имеет многочисленные приложения в статистике вывода , например, в тестах хи-квадрат и в оценке дисперсий . Оно входит в проблему оценки среднего значения нормально распределенной совокупности и в проблему оценки наклона линии регрессии через свою роль в распределении Стьюдента . Оно входит во все проблемы дисперсионного анализа через свою роль в F-распределении , которое является распределением отношения двух независимых случайных величин хи-квадрат , каждая из которых делится на свои соответствующие степени свободы.

Ниже приведены некоторые наиболее распространенные ситуации, в которых распределение хи-квадрат возникает из выборки, распределенной по Гауссу.

- если являются независимыми случайными величинами , то где .

- В таблице ниже показаны некоторые статистические данные, основанные на независимых случайных величинах, распределение вероятностей которых связано с распределением хи-квадрат:

| Имя | Статистика |

|---|---|

| распределение хи-квадрат | |

| нецентральное распределение хи-квадрат | |

| распределение хи | |

| нецентральное распределение хи |

Распределение хи-квадрат также часто встречается в магнитно-резонансной томографии . [21]

Методы расчета

Таблицаχ2ценности противп-ценности

Значение - это вероятность наблюдения тестовой статистики по крайней мере как экстремальной в распределении хи-квадрат. Соответственно, поскольку кумулятивная функция распределения (CDF) для соответствующих степеней свободы (df) дает вероятность получения значения менее экстремального, чем эта точка, вычитание значения CDF из 1 дает p -значение. Низкое p -значение, ниже выбранного уровня значимости, указывает на статистическую значимость , т. е. достаточные доказательства для отклонения нулевой гипотезы. Уровень значимости 0,05 часто используется в качестве границы между значимыми и незначимыми результатами.

В таблице ниже приведен ряд значений p , соответствующих первым 10 степеням свободы.

| Степени свободы (df) | значение [22] | ||||||||||

|---|---|---|---|---|---|---|---|---|---|---|---|

| 1 | 0,004 | 0,02 | 0,06 | 0,15 | 0,46 | 1.07 | 1.64 | 2.71 | 3.84 | 6.63 | 10.83 |

| 2 | 0.10 | 0,21 | 0,45 | 0,71 | 1.39 | 2.41 | 3.22 | 4.61 | 5.99 | 9.21 | 13.82 |

| 3 | 0,35 | 0,58 | 1.01 | 1.42 | 2.37 | 3.66 | 4.64 | 6.25 | 7.81 | 11.34 | 16.27 |

| 4 | 0,71 | 1.06 | 1.65 | 2.20 | 3.36 | 4.88 | 5.99 | 7.78 | 9.49 | 13.28 | 18.47 |

| 5 | 1.14 | 1.61 | 2.34 | 3.00 | 4.35 | 6.06 | 7.29 | 9.24 | 11.07 | 15.09 | 20.52 |

| 6 | 1.63 | 2.20 | 3.07 | 3.83 | 5.35 | 7.23 | 8.56 | 10.64 | 12.59 | 16.81 | 22.46 |

| 7 | 2.17 | 2.83 | 3.82 | 4.67 | 6.35 | 8.38 | 9.80 | 12.02 | 14.07 | 18.48 | 24.32 |

| 8 | 2.73 | 3.49 | 4.59 | 5.53 | 7.34 | 9.52 | 11.03 | 13.36 | 15.51 | 20.09 | 26.12 |

| 9 | 3.32 | 4.17 | 5.38 | 6.39 | 8.34 | 10.66 | 12.24 | 14.68 | 16.92 | 21.67 | 27.88 |

| 10 | 3.94 | 4.87 | 6.18 | 7.27 | 9.34 | 11.78 | 13.44 | 15.99 | 18.31 | 23.21 | 29.59 |

| p -значение (вероятность) | 0,95 | 0,90 | 0,80 | 0,70 | 0,50 | 0.30 | 0.20 | 0.10 | 0,05 | 0.01 | 0,001 |

Эти значения можно рассчитать, оценивая квантильную функцию (также известную как «обратная CDF» или «ICDF») распределения хи-квадрат; [23] например, χ 2 ICDF для p = 0,05 и df = 7 дает 2,1673 ≈ 2,17, как в таблице выше, отметив, что 1 – p является p -значением из таблицы.

История

Это распределение было впервые описано немецким геодезистом и статистиком Фридрихом Робертом Гельмертом в работах 1875–6 гг. [24] [25] , где он вычислил выборочное распределение выборочной дисперсии нормальной совокупности. Таким образом, в немецком языке это традиционно известно как Helmert'sche («Helmertian») или «распределение Гельмерта».

Распределение было независимо переоткрыто английским математиком Карлом Пирсоном в контексте согласия , для чего он разработал свой критерий хи-квадрат Пирсона , опубликованный в 1900 году, с вычисленной таблицей значений, опубликованной в (Elderton 1902), собранной в (Pearson 1914, стр. xxxi–xxxiii, 26–28, таблица XII). Название «хи-квадрат» в конечном итоге происходит от сокращения Пирсона для показателя степени в многомерном нормальном распределении с греческой буквой Хи , записывая −½χ 2 для того, что в современной нотации будет выглядеть как −½ x T Σ −1 x (Σ является ковариационной матрицей ). [26] Однако идея семейства «хи-квадрат распределений» принадлежит не Пирсону, а возникла как дальнейшее развитие благодаря Фишеру в 1920-х годах. [24]

Смотрите также

- Распределение хи

- Масштабированное обратное распределение хи-квадрат

- Гамма-распределение

- Обобщенное распределение хи-квадрат

- Нецентральное распределение хи-квадрат

- Тест хи-квадрат Пирсона

- Сокращенная статистика хи-квадрат

- Лямбда-распределение Уилкса

- Модифицированное полунормальное распределение [27] с функцией плотности вероятности задается как , где обозначает функцию Фокса–Райта Psi .

Ссылки

- ^ MA Sanders. "Характерная функция центрального распределения хи-квадрат" (PDF) . Архивировано из оригинала (PDF) 2011-07-15 . Получено 2009-03-06 .

- ^ Weisstein, Eric W. "Распределение хи-квадрат". mathworld.wolfram.com . Получено 11 октября 2024 г.

- ^ Абрамовиц, Милтон ; Стиган, Ирен Энн , ред. (1983) [июнь 1964]. "Глава 26". Справочник по математическим функциям с формулами, графиками и математическими таблицами . Серия "Прикладная математика". Том 55 (Девятое переиздание с дополнительными исправлениями десятого оригинального издания с исправлениями (декабрь 1972 г.); первое изд.). Вашингтон, округ Колумбия; Нью-Йорк: Министерство торговли США, Национальное бюро стандартов; Dover Publications. стр. 940. ISBN 978-0-486-61272-0. LCCN 64-60036. MR 0167642. LCCN 65-12253.

- ^ NIST (2006). Справочник по инженерной статистике – Распределение хи-квадрат

- ^ abc Джонсон, Н. Л.; Коц, С.; Балакришнан, Н. (1994). «Распределения хи-квадрат, включая хи и Рэлея». Непрерывные одномерные распределения . Том 1 (Второе издание). John Wiley and Sons. С. 415–493. ISBN 978-0-471-58495-7.

- ^ Mood, Alexander; Graybill, Franklin A.; Boes, Duane C. (1974). Введение в теорию статистики (третье изд.). McGraw-Hill. стр. 241–246. ISBN 978-0-07-042864-5.

- ^ "Распределение хи-квадрат" (PDF) . Университет Реджайны .

- ^ Уэстфолл, Питер Х. (2013). Понимание передовых статистических методов . Бока-Ратон, Флорида: CRC Press. ISBN 978-1-4665-1210-8.

- ^ Рэмси, PH (1988). «Оценка нормального приближения к биномиальному тесту». Журнал образовательной статистики . 13 (2): 173–82. doi :10.2307/1164752. JSTOR 1164752.

- ^ ab Lancaster, HO (1969), Распределение хи-квадрат , Wiley

- ^ Дасгупта, Санджой ДА; Гупта, Анупам К. (январь 2003 г.). «Элементарное доказательство теоремы Джонсона и Линденштрауса» (PDF) . Случайные структуры и алгоритмы . 22 (1): 60–65. doi :10.1002/rsa.10073. S2CID 10327785 . Получено 01.05.2012 .

- ^ Распределение хи-квадрат, из MathWorld , получено 11 февраля 2009 г.

- ^ MK Simon, Распределения вероятностей, включающие гауссовские случайные величины , Нью-Йорк: Springer, 2002, ур. (2.35), ISBN 978-0-387-34657-1

- ^ Лоран, Б.; Массарт, П. (2000-10-01). "Адаптивная оценка квадратичного функционала путем выбора модели". Анналы статистики . 28 (5). doi : 10.1214/aos/1015957395 . ISSN 0090-5364. S2CID 116945590.

- ^ Бокс, Хантер и Хантер (1978). Статистика для экспериментаторов . Wiley. стр. 118. ISBN 978-0-471-09315-2.

- ^ Бартлетт, М.С.; Кендалл, Д.Г. (1946). «Статистический анализ дисперсионной неоднородности и логарифмическое преобразование». Приложение к журналу Королевского статистического общества . 8 (1): 128–138. doi :10.2307/2983618. JSTOR 2983618.

- ^ ab Pillai, Natesh S. (2016). «Неожиданная встреча с Коши и Леви». Annals of Statistics . 44 (5): 2089–2097. arXiv : 1505.01957 . doi : 10.1214/15-aos1407. S2CID 31582370.

- ^ Уилсон, ЭБ; Хильферти, ММ (1931). «Распределение хи-квадрат». Proc. Natl. Acad. Sci. USA . 17 (12): 684–688. Bibcode : 1931PNAS...17..684W. doi : 10.1073/pnas.17.12.684 . PMC 1076144. PMID 16577411 .

- ^ Бэкстрём, Т.; Фишер, Дж. (январь 2018 г.). «Быстрая рандомизация для распределенного кодирования речи и звука с низкой скоростью передачи данных» (PDF) . Труды IEEE/ACM по обработке звука, речи и языка . 26 (1): 19–30. doi :10.1109/TASLP.2017.2757601. S2CID 19777585.

- ^ Bausch, J. (2013). "Об эффективном вычислении линейной комбинации случайных величин хи-квадрат с применением в подсчете струнных вакуумов". J. Phys. A: Math. Theor . 46 (50): 505202. arXiv : 1208.2691 . Bibcode : 2013JPhA...46X5202B. doi : 10.1088/1751-8113/46/50/505202. S2CID 119721108.

- ^ den Dekker AJ, Sijbers J., (2014) «Распределение данных в магнитно-резонансных изображениях: обзор», Physica Medica , [1]

- ^ Тест хи-квадрат Архивировано 2013-11-18 в Wayback Machine Таблица B.2. Доктор Жаклин С. Маклафлин из Университета штата Пенсильвания. В свою очередь цитируется: RA Fisher и F. Yates, Статистические таблицы для биологических сельскохозяйственных и медицинских исследований, 6-е изд., Таблица IV. Два значения были исправлены, 7,82 на 7,81 и 4,60 на 4,61

- ^ "Распределение хи-квадрат | Учебник R". www.r-tutor.com .

- ^ ab Hald 1998, стр. 633–692, 27. Выборочные распределения при нормальном распределении.

- ^ Ф. Р. Гельмерт , «Ueber die Wahrscheinlichkeit der Potenzsummen der Beobachtungsfehler und über einige damit im Zusammenhange stehende Fragen», Zeitschrift für Mathematik und Physik 21, 1876, стр. 192–219

- ^ RL Plackett, Karl Pearson and the Chi-Squared Test , International Statistical Review, 1983, 61f. См. также Jeff Miller, Earlyest Known Uses of Some of the Words of Mathematics.

- ^ Сан, Цзинчао; Конг, Майин; Пал, Субхадип (22 июня 2021 г.). «Модифицированное полунормальное распределение: свойства и эффективная схема выборки» (PDF) . Communications in Statistics - Theory and Methods . 52 (5): 1591–1613. doi :10.1080/03610926.2021.1934700. ISSN 0361-0926. S2CID 237919587.

Дальнейшее чтение

- Хальд, Андерс (1998). История математической статистики с 1750 по 1930 год . Нью-Йорк: Wiley. ISBN 978-0-471-17912-2.

- Элдертон, Уильям Пэйлин (1902). «Таблицы для проверки соответствия теории наблюдениям». Biometrika . 1 (2): 155–163. doi :10.1093/biomet/1.2.155.

- «Распределение хи-квадрат», Энциклопедия математики , EMS Press , 2001 [1994]

- Пирсон, Карл (1914). «О вероятности того, что два независимых распределения частот на самом деле являются образцами одной и той же популяции, с особой ссылкой на недавнюю работу по идентичности штаммов трипаносом». Biometrika . 10 : 85–154. doi :10.1093/biomet/10.1.85.

Внешние ссылки

- Самые ранние примеры использования некоторых слов из математики: запись о хи-квадрате имеет краткую историю

- Заметки по курсу «Проверка согласия по критерию хи-квадрат» из курса 101 «Статистика» Йельского университета.

- Демонстрация Mathematica, демонстрирующая распределение выборки хи-квадрат различных статистик, например Σx², для нормальной совокупности

- Простой алгоритм аппроксимации cdf и обратной cdf для распределения хи-квадрат с помощью карманного калькулятора

- Значения распределения хи-квадрат

![{\displaystyle \sum _{t=1}^{n}(Z_{t}-{\bar {Z}})^{2}~=~\sum _{t=1}^{n}Z_{t}^{2}-n{\bar {Z}}^{2}~=~Z^{\top }[1\!\!1-{\textstyle {\frac {1}{n}}}{\bar {1}}{\bar {1}}^{\top }]Z~=:~Z^{\top }\!MZ}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a75244295aa75ce536257678c26cc1ca3976824f)

![{\displaystyle h=\int _{0}^{\infty }f(x;\,k)\ln f(x;\,k)\,dx={\frac {k}{2}}+\ln \left[2\,\Gamma \left({\frac {k}{2}}\right)\right]+\left(1-{\frac {k}{2}}\right)\,\psi \!\left({\frac {k}{2}}\right),}](https://wikimedia.org/api/rest_v1/media/math/render/svg/45e688a3cb0db75d36f895567aa7edeec687ffad)

![{\displaystyle Pr(\|v\|^{2}\in [n-2n^{1/2+\alpha},n+2n^{1/2+\alpha}+2n^{\alpha}] )\geq 1-e^{-n^{\alpha }}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8be3c35f173fbb97941bc94b50986829cd3e3add)

![{\displaystyle {\sqrt[{3}]{X/k}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8bcdb470ed5d9bcbb3a64104d190a9ff620f4048)