Визуальная одометрия

В робототехнике и компьютерном зрении визуальная одометрия — это процесс определения положения и ориентации робота путем анализа связанных изображений с камеры. Она использовалась в самых разных роботизированных приложениях, например, на марсоходах Mars Exploration Rovers . [1]

Обзор

В навигации одометрия — это использование данных о движении приводов для оценки изменения положения с течением времени с помощью таких устройств, как вращающиеся энкодеры для измерения вращения колес. Хотя традиционные методы одометрии полезны для многих колесных или гусеничных транспортных средств, они не могут быть применены к мобильным роботам с нестандартными методами передвижения, например, к роботам на ногах . Кроме того, одометрия повсеместно страдает от проблем с точностью, поскольку колеса имеют тенденцию скользить и скользить по полу, создавая неравномерное пройденное расстояние по сравнению с вращением колес. Ошибка усугубляется, когда транспортное средство работает на негладких поверхностях. Показания одометрии становятся все более ненадежными, поскольку эти ошибки накапливаются и усугубляются со временем.

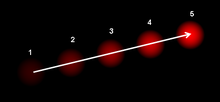

Визуальная одометрия — это процесс определения эквивалентной одометрической информации с использованием последовательных изображений с камеры для оценки пройденного расстояния. Визуальная одометрия позволяет повысить точность навигации в роботах или транспортных средствах, использующих любой тип передвижения на любой [ нужна цитата ] поверхности.

Типы

Существуют различные типы VO.

Монокуляр и стерео

В зависимости от настройки камеры VO можно разделить на следующие категории: монокулярная VO (одна камера) и стерео VO (две камеры в стереосистеме).

Метод, основанный на признаках и прямой метод

Традиционная визуальная информация VO получается с помощью метода на основе признаков, который извлекает характерные точки изображения и отслеживает их в последовательности изображений. Недавние разработки в исследовании VO предоставили альтернативу, называемую прямым методом, который использует интенсивность пикселей в последовательности изображений напрямую в качестве визуального ввода. Существуют также гибридные методы.

Визуальная инерциальная одометрия

Если в системе VO используется инерциальный измерительный блок (IMU), его обычно называют визуальной инерциальной одометрией (VIO).

Алгоритм

Большинство существующих подходов к визуальной одометрии основаны на следующих этапах.

- Получение входных изображений: с помощью отдельных камер , [2] [3] стереокамер , [3] [4] или всенаправленных камер . [5] [6]

- Коррекция изображения: применение методов обработки изображений для устранения искажений объектива и т. д.

- Обнаружение признаков : определение интересующих операторов, сопоставление признаков по кадрам и построение поля оптического потока .

- Извлечение признаков и корреляция.

- Для установления соответствия двух изображений используйте корреляцию, а не долгосрочное отслеживание признаков .

- Построить оптическое поле потока ( метод Лукаса–Канаде ).

- Извлечение признаков и корреляция.

- Проверьте векторы поля потока на наличие потенциальных ошибок отслеживания и удалите выбросы. [7]

- Оценка движения камеры по оптическому потоку. [8] [9] [10] [11]

- Вариант 1: Фильтр Калмана для поддержания распределения оценок состояния.

- Выбор 2: найти геометрические и 3D свойства признаков, которые минимизируют функцию стоимости на основе ошибки повторного проецирования между двумя соседними изображениями. Это можно сделать с помощью математической минимизации или случайной выборки .

- Периодическое повторное заполнение точек трекинга для поддержания покрытия по всему изображению.

Альтернативой методам, основанным на признаках, является метод «прямой» или визуальной одометрии, основанный на внешнем виде, который минимизирует ошибку непосредственно в пространстве датчика и впоследствии позволяет избежать сопоставления и извлечения признаков. [4] [12] [13]

Другой метод, названный «визиодометрией», оценивает плоские ротационные перемещения между изображениями, используя фазовую корреляцию вместо извлечения признаков. [14] [15]

Эгомоция

Egomotion определяется как 3D-движение камеры в среде. [16] В области компьютерного зрения egomotion относится к оценке движения камеры относительно жесткой сцены. [17] Примером оценки egomotion может быть оценка положения движущегося автомобиля относительно линий на дороге или уличных знаков, наблюдаемых из самого автомобиля. Оценка egomotion важна в автономных навигационных приложениях роботов. [18]

Обзор

Цель оценки эгодвижения камеры — определить трехмерное движение этой камеры в среде с помощью последовательности изображений, снятых камерой. [19] Процесс оценки движения камеры в среде включает использование методов визуальной одометрии на последовательности изображений, снятых движущейся камерой. [20] Обычно это делается с помощью обнаружения признаков для построения оптического потока из двух кадров изображения в последовательности [16], сгенерированной либо с одной камеры, либо с стереокамер. [20] Использование пар стереоизображений для каждого кадра помогает уменьшить ошибку и обеспечивает дополнительную информацию о глубине и масштабе. [21] [22]

Особенности обнаруживаются в первом кадре, а затем сопоставляются во втором кадре. Затем эта информация используется для создания поля оптического потока для обнаруженных особенностей на этих двух изображениях. Поле оптического потока иллюстрирует, как особенности расходятся из одной точки, фокуса расширения . Фокус расширения может быть обнаружен из поля оптического потока, указывая направление движения камеры и, таким образом, предоставляя оценку движения камеры.

Существуют и другие методы извлечения информации об эгомоциях из изображений, включая метод, который избегает обнаружения признаков и полей оптического потока, а напрямую использует интенсивности изображений. [16]

Смотрите также

Ссылки

- ^ Maimone, M.; Cheng, Y.; Matthies, L. (2007). «Два года визуальной одометрии на марсоходах» (PDF) . Journal of Field Robotics . 24 (3): 169– 186. CiteSeerX 10.1.1.104.3110 . doi :10.1002/rob.20184. S2CID 17544166 . Получено 10 июля 2008 г. .

- ^ Chhaniyara, Savan; KASPAR ALTHOEFER; LAKMAL D. SENEVIRATNE (2008). "Visual Odometry Technique Using Circular Marker Identification For Motion Parameter Estimation". Advances in Mobile Robotics: Proceedings of the Eleventh International Conference on Climbing and Walking Robots and the Support Technologies for Mobile Machines, Coimbra, Portugal . The Eleventh International Conference on Climbing and Walking Robots and the Support Technologies for Mobile Machines. Vol. 11. World Scientific, 2008. Архивировано из оригинала 24.02.2012 . Получено 22.01.2010 .

- ^ ab Nister, D; Naroditsky, O.; Bergen, J (январь 2004 г.). Визуальная одометрия . Компьютерное зрение и распознавание образов, 2004. CVPR 2004. Том 1. стр. I–652 – I–659 Том 1. doi :10.1109/CVPR.2004.1315094.

- ^ ab Comport, AI; Malis, E.; Rives, P. (2010). F. Chaumette; P. Corke; P. Newman (ред.). "Квадрифокальная визуальная одометрия в реальном времени". International Journal of Robotics Research . 29 ( 2– 3): 245– 266. CiteSeerX 10.1.1.720.3113 . doi : 10.1177/0278364909356601. S2CID 15139693.

- ^ Скарамуцца, Д.; Зигварт, Р. (октябрь 2008 г.). «Внешний вид-управляемой монокулярной всенаправленной визуальной одометрии для уличных наземных транспортных средств». Труды IEEE по робототехнике . 24 (5): 1015– 1026. doi : 10.1109/TRO.2008.2004490. hdl : 20.500.11850/14362 . S2CID 13894940.

- ^ Corke, P.; Strelow, D.; Singh, S. "Всенаправленная визуальная одометрия для планетарного вездехода". Интеллектуальные роботы и системы, 2004. (IROS 2004). Труды. Международная конференция IEEE/RSJ 2004 г. по . Том 4. doi :10.1109/IROS.2004.1390041.

- ^ Кэмпбелл, Дж.; Суктанкар, Р.; Нурбакхш, И.; Питтсбург, И. Р. "Методы оценки оптического потока для визуальной одометрии в экстремальных условиях". Интеллектуальные роботы и системы, 2004. (IROS 2004). Труды. Международная конференция IEEE/RSJ 2004 г. по . Том 4. doi :10.1109/IROS.2004.1389991.

- ^ Сандерхауф, Н.; Конолиге, К.; Лакруа, С.; Протцель, П. (2005). «Визуальная одометрия с использованием регулировки разреженного пучка на автономном открытом транспортном средстве». В Леви; Шанц; Лафренц; Аврутин (ред.). Автономная мобильная система Tagungsband 2005 (PDF) . Актуальная информация. Спрингер Верлаг. стр. 157–163 . Архивировано из оригинала (PDF) 11 февраля 2009 г. Проверено 10 июля 2008 г.

- ^ Konolige, K.; Agrawal, M.; Bolles, RC; Cowan, C.; Fischler, M.; Gerkey, BP (2008). «Наружное картографирование и навигация с использованием стереозрения». Experimental Robotics . Springer Tracts in Advanced Robotics. Vol. 39. pp. 179– 190. doi :10.1007/978-3-540-77457-0_17. ISBN 978-3-540-77456-3.

- ^ Olson, CF; Matthies, L.; Schhoppers, M.; Maimone, MW (2002). "Навигация вездехода с использованием стерео ego-motion" (PDF) . Робототехника и автономные системы . 43 (4): 215– 229. doi :10.1016/s0921-8890(03)00004-6 . Получено 2010-06-06 .

- ^ Cheng, Y.; Maimone, MW; Matthies, L. (2006). «Визуальная одометрия на марсоходах». Журнал IEEE Robotics and Automation . 13 (2): 54– 62. CiteSeerX 10.1.1.297.4693 . doi :10.1109/MRA.2006.1638016. S2CID 15149330.

- ^ Энгель, Якоб; Шёпс, Томас; Кремерс, Дэниел (2014). "LSD-SLAM: Крупномасштабный прямой монокулярный SLAM" (PDF) . В Fleet D.; Pajdla T.; Schiele B.; Tuytelaars T. (ред.). Компьютерное зрение . Европейская конференция по компьютерному зрению 2014. Конспект лекций по информатике. Том 8690. doi :10.1007/978-3-319-10605-2_54.

- ^ Энгель, Якоб; Штурм, Юрген; Кремерс, Дэниел (2013). «Полуплотная визуальная одометрия для монокулярной камеры» (PDF) . Международная конференция IEEE по компьютерному зрению (ICCV) . CiteSeerX 10.1.1.402.6918 . doi :10.1109/ICCV.2013.183.

- ^ Заман, М. (2007). «Высокоточная относительная локализация с использованием одной камеры». Робототехника и автоматизация, 2007. (ICRA 2007). Труды. Международная конференция IEEE 2007 г. по . doi :10.1109/ROBOT.2007.364078.

- ^ Заман, М. (2007). «Высокоточная относительная локализация с использованием двух камер». Журнал робототехники и автономных систем . 55 (9): 685– 692. doi :10.1016/j.robot.2007.05.008.

- ^ abc Irani, M.; Rousso, B.; Peleg S. (июнь 1994 г.). «Восстановление движения эго с использованием стабилизации изображения» (PDF) . Конференция компьютерного общества IEEE по компьютерному зрению и распознаванию образов : 21– 23 . Получено 7 июня 2010 г. .

- ^ Burger, W.; Bhanu, B. (ноябрь 1990 г.). «Оценка 3D-эгодвижения из последовательности перспективных изображений». Труды IEEE по анализу образов и машинному интеллекту . 12 (11): 1040– 1058. doi :10.1109/34.61704. S2CID 206418830.

- ^ Shakernia, O.; Vidal, R.; Shankar, S. (2003). "Omnidirectional Egomotion Estimation From Back-projection Flow" (PDF) . Конференция по компьютерному зрению и семинар по распознаванию образов . 7 : 82. CiteSeerX 10.1.1.5.8127 . doi :10.1109/CVPRW.2003.10074. S2CID 5494756 . Получено 7 июня 2010 г. .

- ^ Tian, T.; Tomasi, C.; Heeger, D. (1996). "Сравнение подходов к вычислению эгомоций" (PDF) . Конференция компьютерного общества IEEE по компьютерному зрению и распознаванию образов : 315. Архивировано из оригинала (PDF) 8 августа 2008 г. . Получено 7 июня 2010 г. .

- ^ ab Milella, A.; Siegwart, R. (январь 2006 г.). "Stereo-Based Ego-Motion Estimation Using Pixel Tracking and Iterative Closest Point" (PDF) . Международная конференция IEEE по системам компьютерного зрения : 21. Архивировано из оригинала (PDF) 17 сентября 2010 г. . Получено 7 июня 2010 г. .

- ^ Olson, CF; Matthies, L.; Schhoppers, M.; Maimoneb MW (июнь 2003 г.). "Навигация вездехода с использованием стерео ego-motion" (PDF) . Робототехника и автономные системы . 43 (9): 215– 229. doi :10.1016/s0921-8890(03)00004-6 . Получено 7 июня 2010 г. .

- ^ Судин Динеш, Котешвара Рао, К.; Унникришнан, М.; Бринда, В.; Лалитамбика, В.Р.; Декане, М.В. «Улучшения в алгоритме визуальной одометрии для планетарных исследовательских вездеходов». Международная конференция IEEE по новым тенденциям в области связи, управления, обработки сигналов и вычислительных приложений (C2SPCA), 2013 г.