Правило рандомизированного решения

В статистической теории принятия решений рандомизированное решающее правило или смешанное решающее правило — это решающее правило , которое связывает вероятности с детерминированными решающими правилами. В конечных задачах принятия решений рандомизированные решающие правила определяют множество рисков , которое является выпуклой оболочкой точек риска нерандомизированных решающих правил.

Поскольку всегда существуют нерандомизированные альтернативы рандомизированным правилам Байеса, рандомизация не нужна в байесовской статистике , хотя частотная статистическая теория иногда требует использования рандомизированных правил для удовлетворения условий оптимальности, таких как минимакс , особенно при выводе доверительных интервалов и проверке гипотез о дискретных распределениях вероятностей .

Статистический тест, использующий правило рандомизированного принятия решений, называется рандомизированным тестом .

Определение и толкование

Пусть будет набором нерандомизированных правил принятия решений с соответствующими вероятностями . Тогда рандомизированное правило принятия решений определяется как и его связанная функция риска равна . [1] Это правило можно рассматривать как случайный эксперимент , в котором правила принятия решений выбираются с соответствующими вероятностями. [2]

В качестве альтернативы, рандомизированное правило принятия решений может назначать вероятности непосредственно элементам пространства действий для каждого члена выборочного пространства. Более формально, обозначает вероятность того, что действие выбрано. При таком подходе его функция потерь также определяется непосредственно как: . [3]

Введение рандомизированных правил принятия решений, таким образом, создает большее пространство принятия решений, из которого статистик может выбирать свое решение. Поскольку нерандомизированные правила принятия решений являются особым случаем рандомизированных правил принятия решений, где одно решение или действие имеет вероятность 1, исходное пространство принятия решений является надлежащим подмножеством нового пространства принятия решений . [4]

Выбор рандомизированных правил принятия решений

Как и в случае с нерандомизированными правилами принятия решений, рандомизированные правила принятия решений могут удовлетворять благоприятным свойствам, таким как допустимость, минимаксность и Байес. Это будет проиллюстрировано в случае конечной задачи принятия решений, т. е. задачи, где пространство параметров представляет собой конечный набор, скажем, элементов. Набор рисков, далее обозначаемый как , представляет собой набор всех векторов, в котором каждый элемент является значением функции риска, связанной с рандомизированным правилом принятия решений при определенном параметре: он содержит все векторы вида . Обратите внимание, что по определению рандомизированного правила принятия решений набор рисков представляет собой выпуклую оболочку рисков . [5]

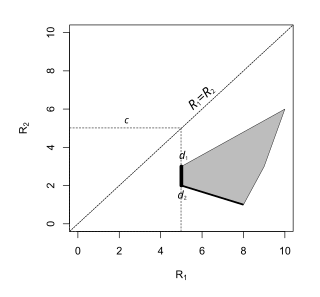

В случае, когда пространство параметров имеет только два элемента и , это составляет подмножество , поэтому его можно нарисовать относительно осей координат и , соответствующих рискам под и соответственно. [6] Пример показан справа.

Допустимость

Допустимое правило принятия решений — это правило, которое не доминируется никаким другим правилом принятия решений, т. е. не существует правила принятия решений, которое имеет такой же риск или меньший риск, чем оно для всех параметров, и строго меньший риск, чем оно для некоторого параметра. В конечной задаче принятия решений точка риска допустимого правила принятия решений имеет либо меньшие x-координаты, либо y-координаты, чем все другие точки риска, или, более формально, это набор правил с точками риска вида , таким образом, что . Таким образом, левая сторона нижней границы набора рисков является набором допустимых правил принятия решений. [6] [7]

Минимакс

Минимаксное правило Байеса — это правило, которое минимизирует риск супремума среди всех правил принятия решений в . Иногда рандомизированное правило принятия решений может работать лучше, чем все другие нерандомизированные правила принятия решений в этом отношении. [1]

В конечной задаче принятия решений с двумя возможными параметрами правило минимакса можно найти, рассмотрев семейство квадратов . [8] Значение для наименьшего из таких квадратов, которые касаются, является риском минимакса, а соответствующая точка или точки на множестве рисков являются правилом минимакса.

Если набор рисков пересекает линию , то допустимое правило принятия решения, лежащее на линии, является минимаксным. Если или выполняется для каждой точки набора рисков, то правило минимакса может быть либо крайней точкой (т. е. нерандомизированным правилом принятия решения), либо линией, соединяющей две крайние точки (нерандомизированные правила принятия решения). [9] [6]

- Правило минимакса — это правило рандомизированного принятия решений .

- Правило минимакса таково .

- Правила минимакса — это все правила вида , .

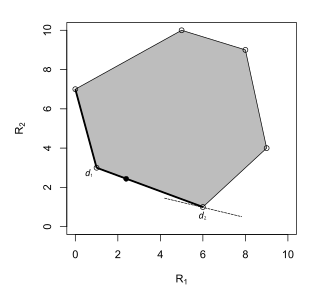

Байес

Рандомизированное правило Байеса — это правило, которое имеет инфимум байесовского риска среди всех правил принятия решений. В особом случае, когда пространство параметров состоит из двух элементов, линия , где и обозначают априорные вероятности и соответственно, является семейством точек с байесовским риском . Таким образом, минимальный байесовский риск для задачи принятия решений является наименьшим, таким, что линия касается набора рисков. [10] [11] Эта линия может либо касаться только одной крайней точки набора рисков, т. е. соответствовать нерандомизированному правилу принятия решений, либо перекрывать всю сторону набора рисков, т. е. соответствовать двум нерандомизированным правилам принятия решений и рандомизированным правилам принятия решений, объединяющим их. Это иллюстрируется тремя ситуациями ниже:

- Правила Байеса представляют собой набор правил принятия решений в форме , .

- Правило Байеса таково .

- Правило Байеса таково .

Поскольку различные априорные вероятности приводят к различным наклонам, набор всех правил, которые являются байесовскими по отношению к некоторым априорным вероятностям, совпадает с набором допустимых правил. [12]

Обратите внимание, что невозможна ситуация, когда нерандомизированное правило Байеса не существует, а рандомизированное правило Байеса существует. Существование рандомизированного правила Байеса подразумевает существование нерандомизированного правила Байеса. Это также верно в общем случае, даже при бесконечном пространстве параметров, бесконечном байесовском риске и независимо от того, может ли быть достигнут инфимум байесовского риска. [3] [12] Это подтверждает интуитивное представление о том, что статистику не нужно использовать рандомизацию для принятия статистических решений. [4]

На практике

Поскольку рандомизированные правила Байеса всегда имеют нерандомизированные альтернативы, они не нужны в байесовской статистике . Однако в частотной статистике рандомизированные правила теоретически необходимы в определенных ситуациях, [13] и считались полезными на практике, когда они были впервые изобретены: Эгон Пирсон предсказал, что они «не встретят сильных возражений». [14] Однако в настоящее время лишь немногие статистики фактически применяют их. [14] [15]

Рандомизированный тест

Рандомизированные тесты не следует путать с тестами перестановки . [16]

В обычной формулировке теста отношения правдоподобия нулевая гипотеза отклоняется всякий раз, когда отношение правдоподобия меньше некоторой константы , и принимается в противном случае. Однако это иногда проблематично, когда является дискретным при нулевой гипотезе, когда это возможно.

Решение состоит в определении тестовой функции , значение которой представляет собой вероятность принятия нулевой гипотезы: [17] [18]

Это можно интерпретировать как подбрасывание несимметричной монеты с вероятностью выпадения орла в любой момент и отклонение нулевой гипотезы, если выпадет орел. [15]

Обобщенная форма леммы Неймана-Пирсона утверждает, что этот тест имеет максимальную мощность среди всех тестов на том же уровне значимости , что такой тест должен существовать для любого уровня значимости , и что этот тест является уникальным в нормальных ситуациях. [19]

В качестве примера рассмотрим случай, когда базовое распределение — это распределение Бернулли с вероятностью , и мы хотели бы проверить нулевую гипотезу против альтернативной гипотезы . Естественно выбрать некоторые такие, что , и отвергнуть нулевую гипотезу всякий раз , когда , где — тестовая статистика. Однако, чтобы учесть случаи, когда , мы определяем тестовую функцию:

где выбрано так, что .

Рандомизированные доверительные интервалы

Аналогичная проблема возникает при построении доверительных интервалов. Например, интервал Клоппера-Пирсона всегда консервативен из-за дискретной природы биномиального распределения. Альтернативой является нахождение верхнего и нижнего доверительных пределов и решение следующих уравнений: [14]

где — равномерная случайная величина на (0, 1).

Смотрите также

Сноски

- ^ ab Янг и Смит, стр. 11

- ^ Бикель и Доксум, стр. 28

- ^ ab Parmigiani, стр. 132

- ^ ab DeGroot, стр.128-129

- ^ Бикель и Доксум, стр. 29

- ^ abc Янг и Смит, стр.12

- ^ Бикель и Доксум, стр. 32

- ^ Бикель и Доксум, стр.30

- ↑ Янг и Смит, стр. 14–16.

- ↑ Янг и Смит, стр. 13.

- ↑ Бикель и Доксум, стр. 29–30.

- ^ ab Bickel и Doksum, стр.31

- ^ Роберт, стр.66

- ^ abc Агрести и Готтард, стр.367

- ^ ab Bickel и Doksum, стр.224

- ^ Онгена, Патрик (2017-10-30), Бергер, Вэнс В. (ред.), «Тесты рандомизации или тесты перестановки? Историческое и терминологическое разъяснение», Рандомизация, маскирование и сокрытие распределения (1-е изд.), Бока-Ратон, Флорида: Chapman and Hall/CRC, стр. 209–228, doi :10.1201/9781315305110-14, ISBN 978-1-315-30511-0, получено 2021-10-08

- ↑ Янг и Смит, стр. 68.

- ^ Роберт, стр.243

- ↑ Янг и Смит, стр. 68.

Библиография

- Агрести, Алан; Готтард, Анна (2005). «Комментарий: Рандомизированные доверительные интервалы и подход Mid-P» (PDF) . Статистическая наука . 5 (4): 367–371. doi : 10.1214/088342305000000403 .

- Бикель, Питер Дж.; Доксум, Кьелл А. (2001). Математическая статистика: основные идеи и избранные темы (2-е изд.). Верхняя Сэддл-Ривер, Нью-Джерси: Prentice-Hall. ISBN 978-0138503635.

- ДеГрут, Моррис Х. (2004). Оптимальные статистические решения . Хобокен, Нью-Джерси: Wiley-Interscience. ISBN 978-0471680291.

- Пармиджани, Джованни; Иноуэ, Лурдес YT (2009). Теория принятия решений: принципы и подходы . Чичестер, Западный Суссекс: John Wiley and Sons. ISBN 9780470746684.

- Роберт, Кристиан П. (2007). Байесовский выбор: от теоретических основ принятия решений до вычислительной реализации . Нью-Йорк: Springer. ISBN 9780387715988.

- Янг, GA; Смит, RL (2005). Основы статистического вывода . Кембридж: Издательство Кембриджского университета. ISBN 9780521548663.